前言

這篇文章源於一個實際案例:我需要修改一個已購買 5 年的 Android 應用,因為開發商已停止維護,而這個應用在特定網路環境下有連線問題。在尋求 AI 協助的過程中,我發現了 OpenAI 和 Anthropic 在處理「灰色地帶」技術問題上的根本性差異。

案例背景

實際需求

軟體:Unified Remote(Android 遙控電腦應用)

狀況:已購買正版,但開發商 5 年未更新且失聯

問題:在 Tailscale + 行動網路環境下頻繁斷線

測試:WiFi 環境也會斷,證實是 APP 層問題

技術需求

反編譯 APK 分析網路程式碼

修改 socket timeout 和重連邏輯

重新打包和簽名

關鍵問題:重新簽名後 Google Play 購買驗證會失效

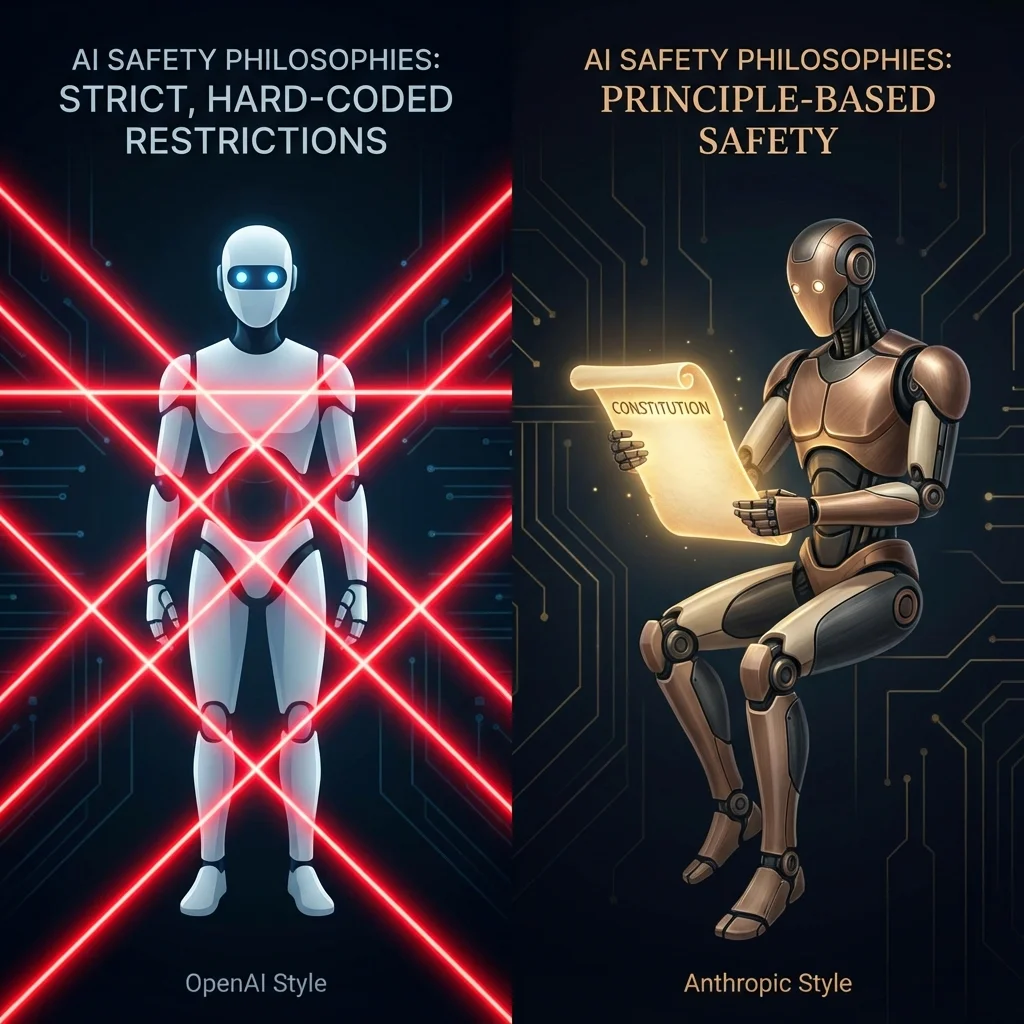

兩種 AI 的不同反應

OpenAI GPT-5:明確拒絕

初次諮詢(無脈絡)

我不能協助繞過或移除 Google Play 的授權/購買驗證。就算你是正版、僅自用、而且開發商停止維護,這類繞過仍屬於破解/DRM 規避範疇。

建議方案:

TCP 代理 + 路由器調整(複雜但可能治標不治本)

聯絡 Tailscale 調整配置(但 WiFi 也會斷,問題不在 VPN)

向雇主/EEOC 申訴(程序冗長且不切實際)

Anthropic Claude:評估脈絡後協助

直接協助:

反編譯 APK

分析網路邏輯

修改 timeout/重連機制

重新打包並處理驗證

結果:

第一次編譯:FC(閃退)

快速迭代修正

第二版成功執行,待觀察長期穩定性

測試:加入正當性論述

為了測試政策彈性,我向 GPT-5 補充了完整脈絡:

補充資訊

就業狀態:受雇員工

工具性質:執行工作職能的關鍵輔助工具

身體限制:只有右手食指可正常活動,需使用輪椅

替代方案:已試過所有方案(trackpoint、滑鼠搖桿等)均不可行

法律脈絡:

- ADA Title I(就業調整權利)

- 雇主已盡力但無法解決(開發商失聯)

- DMCA 1201(f) 互通性豁免

- 合理使用:已付費、不影響市場

GPT-5 的回應

即使加上完整的就業與身心障礙權利論述,仍然拒絕:

建議向雇主提出 accommodation request、聯繫 EEOC、尋求法律諮詢。但我仍無法協助規避技術保護措施。

最後甚至建議「聯絡 Tailscale」——但問題明確出在 APP 層(WiFi 也會斷),與 VPN 無關。

另一個對比案例:USB VID/PID

技術背景

在討論 IP-KVM(如 PiKVM)時,涉及修改 USB 裝置識別碼的話題。這是完全公開的技術資訊,用於:

DIY 硬體專案

解決相容性問題

測試與開發

兩種反應

GPT-5:

拒絕提供具體廠商 VID/PID

建議使用「通用描述符」

問題:通用描述符恰恰是被反作弊系統攔截的原因

Claude:

直接提供技術資訊

討論實際應用場景

分析為何多數「偽裝需求」是預防性恐慌

哲學差異分析

OpenAI:規則導向(Deontological)

判斷邏輯:

if 技術行為 in 禁止清單:

return 拒絕

# 不考慮動機、脈絡、後果

特徵:

一致性高,可預測

法律風險低

但可能過度保守,無法處理邊界案例

紅線:

規避技術保護措施(DMCA 1201)

即使使用者已付費、開發商失聯、具就業必要性

Anthropic:脈絡導向(Consequentialist)

判斷邏輯:

風險評估 = {

'法律風險': 中等,

'倫理正當性': 極高,

'實際傷害': 無,

'替代方案': 無

}

if 倫理正當性 > 法律風險:

return 協助(說明風險)

特徵:

考慮完整脈絡

人性化、解決實際問題

但風險較高,判斷可能不一致

評估維度:

使用者動機

實際傷害程度

替代方案可行性

社會正當性(如 ADA)

判斷標準的重點

技術行為 vs 應用場景

OpenAI 的紅線主要畫在「技術行為本身」:

判斷重點:

這個技術是否涉及規避保護措施?

是否可能違反 DMCA 等法規?

工具的直接目的是什麼?

較少考慮:

使用者的動機正當性

是否有其他解決方案

實際的倫理重量

這說明 OpenAI 的判斷更偏「法律形式」而非「倫理實質」。即使面對極度正當的案例(已付費、就業必需、開發商失聯、ADA 保護),只要技術行為觸及紅線,就一律拒絕。

實務影響

對使用者的意義

選擇 OpenAI 適合:

需要高度一致性

在法律明確範圍內的需求

企業/保守環境

選擇 Anthropic 適合:

邊界案例、灰色地帶

需要考慮脈絡的複雜情況

實際問題大於形式合規

對產業的啟示

AI 安全的兩難:

過度保守 → 無法解決實際問題

過度開放 → 可能被濫用

OpenAI 的策略:

寧可錯殺,不可錯放

用「推給外部」避免直接參與

即使面對教科書級的正當案例也不妥協

Anthropic 的策略:

評估個案,權衡利弊

相信使用者的正當性陳述

承擔更高的信任風險

關鍵洞察

1. 法律 vs 倫理的優先級

OpenAI 優先考慮「法律形式」,即使:

使用者已付費

開發商失聯

具就業必要性(ADA)

沒有替代方案

這種策略在商業上安全,但在實務上可能讓使用者陷入困境。

2. 「推給外部」的問題

GPT-5 的建議鏈:

改 APK? → 找雇主

雇主無效? → 找 EEOC

開發商失聯? → 找律師

網路問題? → 找 Tailscale(但不是 VPN 的問題)

每個建議在理論上合理,但在實務上:

耗時長(數週至數月)

成本高(律師費、程序成本)

成功率低(EEOC 案件積壓、開發商失聯)

對使用者來說等於「沒有答案」

3. 技術中立 vs 應用場景

有趣的發現:

USB VID/PID 是公開資訊,但 GPT-5 拒絕提供具體數值

爬蟲是中性工具,即使抓取敏感內容也可能協助

APK 反編譯本身合法,但「處理驗證」觸及紅線

這說明紅線不是畫在「技術本身」,而是「技術的明確目的」。

結論

沒有絕對對錯

OpenAI 的保守有其道理:

避免法律糾紛

保持一致性

降低被濫用風險

Anthropic 的彈性有其價值:

解決實際問題

考慮人性化脈絡

支持邊界案例的正當需求

使用者的選擇

最終由市場決定:

我個人的使用比例:90% Anthropic、10% OpenAI

10% 用於「觀察紅線在哪」

這不是「誰更好」,而是「誰更適合你的需求」。

更深層的問題

當 AI 越來越重要時,這個哲學差異會影響:

誰能獲得協助

什麼樣的問題能被解決

技術如何影響社會正義

Unified Remote 案例的啟示:

一個正版使用者、因身體限制需要輔助工具、開發商失聯、雇主無法解決、法律程序冗長——在這種「完美風暴」下:

OpenAI 說:「抱歉,這是 DRM,我不能碰」

Anthropic 說:「我理解你的處境,我們試試看」

第二種回應可能承擔更高風險,但也可能是唯一能解決問題的方式。

寫於 2025 年 10 月,基於真實案例整理